AI角色聊天应用,例如PolyBuzz.ai,允许孩子和几乎任何其他人与模仿名人或虚构人物的虚拟角色聊天,这些虚拟角色由先进的人工智能模型提供支持。这些应用程序因其互动性和娱乐性而深受儿童欢迎,给人一种陪伴和逃避现实的感觉。

然而,这些应用程序也带来了相当多的风险,包括隐私问题、错误信息、对虚拟角色的无意情感依恋、不适当的内容以及潜在的掠夺者利用。虽然家长控制可以尝试阻止访问,但孩子们经常使用巧妙的技术绕过它们,这凸显了信任和沟通的必要性,而不是仅靠技术保障。

目录

我们认为,父母能做的最好的事情就是教育孩子有关人工智能的知识,设定明确的使用界限,并鼓励批判性思维来质疑人工智能的反应。关注现实世界的社交互动还可以帮助孩子平衡数字参与,减少他们对人工智能情感支持的依赖。如果您可以与您的孩子进行公开对话,并且他们愿意与您分享他们的经验,这可以帮助缓解这些工具即将出现的安全问题。

AI角色聊天应用程序的兴起

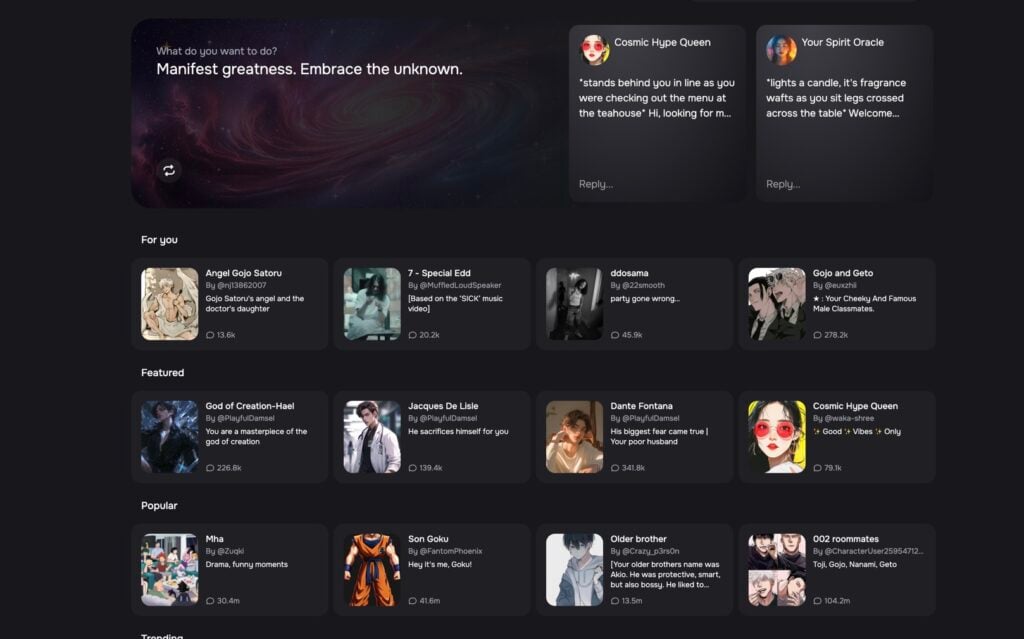

人工智能角色聊天应用程序利用自然语言处理来模拟类人交互,允许用户与可自定义的角色进行互动。例如,Character.AI 拥有超过 2000 万用户,孩子们喜欢与 Harry Styles、Peter Parker 或 Percy Jackson 等人物对话。

这些应用程序因其有趣、现实的性质而广受欢迎。他们让孩子们与他们互动或创造让他们感兴趣或兴奋的角色。然而,它们的易用性和吸引力引起了重大的安全问题,特别是对于年轻用户而言。

与人工智能聊天应用程序相关的详细风险

风险很大,影响隐私、情绪健康和安全:

- 隐私问题:这些应用程序收集用户数据,包括个人详细信息和对话历史记录,这些数据可能会在未经同意的情况下被滥用或共享。一篇文章由莫比西普强调指出,Character.AI 的隐私政策规定服务不面向未成年人,但执行力度薄弱,可能使儿童面临数据泄露和利用的风险。

- 误传:人工智能聊天机器人可能会提供不准确或误导性的信息,儿童可能会在未经验证的情况下接受这些信息。研究来自库斯托迪奥指出,Character.AI 的个性化互动可能会导致错误学习,尤其是考虑到孩子们对人工智能反应的信任。

- 情感依恋:孩子们可能会与虚拟角色建立牢固的联系,几乎取代了人际关系。 Ekaterina Pashevich 最近的一项研究被引用于保险箱警告说,定期互动可能会影响社会发展,因为人工智能缺乏人类接触的情感深度和同理心。

- 不当内容:某些角色,例如 Character.AI 上的“有毒男友”或“出轨女友”,可能会导致有害或露骨的对话。由于 NSFW 过滤器薄弱,孩子们可以绕过这些过滤器,从而导致接触不合适或色情内容,从而进一步增加了这种风险。

- 开发潜力:掠夺者或诈骗者也利用这些平台来瞄准儿童,利用他们的不成熟和信任。 2024 年,一名 14 岁的青少年在与 Character.ai 角色互动后自杀,详细信息请参见新闻周刊文章。

根据 2025 年电子安全专员的说法博客在人工智能聊天机器人方面,100 多个可用的人工智能伴侣中的大多数几乎没有甚至为零的年龄限制,而且许多都是在没有适当安全控制的情况下向年轻用户推销的。

参见:新的 AI Trust 评分显示 DeepSeek 在敏感信息披露方面处于领先地位

家长控制的局限性

不幸的是,虽然家长控制可以限制应用程序访问或屏幕时间,但它们远非万无一失。众所周知,孩子们精通技术,可以使用朋友的设备或通过 VPN 轻松绕过控制。孩子们找到了规避限制的创造性方法,这意味着大多数技术保障措施都无法解决这些问题。这些限制凸显了信任和开放沟通的必要性,以补充而不是取代这些工具。

建立信任和开放的沟通:家长策略

为了降低风险,父母必须优先考虑建立信任和保持持续的对话。一些关键策略包括:

- 对孩子进行人工智能教育:家长应解释人工智能的工作原理和风险,例如侵犯隐私和错误信息。如果父母不熟悉人工智能和更广泛的人工智能领域,他们就必须自己学习一些知识。 2023年麻省理工科技评论文章建议尽早开始对话,使用开放式问题,例如“这周你使用过任何新的人工智能工具吗?”让谈话继续进行。

- 设定清晰的界限:制定一些有关应用程序使用、上网时间等的基本规则,并尝试解释您的理由,以建立信任并让孩子们站在您这边。例如,使用限制聊天时间屏幕时间在 iPhone 或阻止互联网使用通过您的路由器。

- 鼓励批判性思维:教孩子质疑人工智能的反应,验证来自可靠来源的信息。这种方法将有助于减轻错误信息风险。

- 促进现实世界的社交互动:鼓励体育或家庭郊游等活动,以平衡数字化参与,减少对人工智能的情感依赖。研究表明,强调人与人之间的联系可以抵消与人工智能同伴的孤立。

治疗师喜欢艾米丽·海门丁格来自科罗拉多大学安舒茨分校的研究人员支持这些策略。它们有助于解决人工智能的“同理心差距”,即聊天机器人无法理解孩子的情感需求。

给家长的实用建议:你可以做什么

对于可行的步骤,家长可以采取以下措施:

- 随时了解情况:通过免费资源(例如Coursera,其中列出了孩子们使用的顶级人工智能平台,包括 Character.AI 和 Snapchat 的 MyAI。

- 以身作则:树立负责任的科技使用习惯,例如限制个人屏幕时间以及在外出或家庭聚餐时避免使用屏幕。

- 寻求专家建议:如果有需要,请考虑咨询经过培训的专业人员,尤其是在心理健康问题方面。这有助于促进有关在线活动的公开对话。

比较分析:技术方法与沟通方法

为了让您了解技术策略和沟通策略之间的平衡,请考虑下表比较有效性:

| 方法 | 优势 | 局限性 |

|---|---|---|

| 家长控制 | 阻止访问、限制屏幕时间 | 很容易绕过,无法解决根本原因 |

| 开放式沟通 | 建立信任、风险教育、促进对话 | 需要持续努力,可能会面临阻力 |

| 组合方法 | 全面、适应新出现的风险 | 需要父母的时间和参与 |

最好的方法是将技术和沟通策略结合起来,但这需要大量的前期工作以及持续的时间和资源来进行监控、交谈和指导。

结论和未来的考虑

总之,保护您的孩子免受人工智能角色聊天应用程序风险需要的不仅仅是技术保障,还需要家长通过公开对话和建立信任积极参与。通过教育您的孩子、设定适当的界限并促进现实世界的互动,您可以减少我们上面讨论的隐私、情感和安全风险。随着人工智能的发展,了解最新的人工智能工具并调整策略对于确保您的孩子能够安全地驾驭数字环境至关重要。